2025年10月18日(土)に第172回「千葉授業づくり研究会」が開催されました。今回のテーマは「テクノロジーで拓く、誰もが暮らしやすい社会 〜視覚障害者支援の最前線から考える〜」。コンピュータサイエンス研究所 営業企画・企画開発統括部長 髙田 将平さんを講師にお招きして講演いただきました。

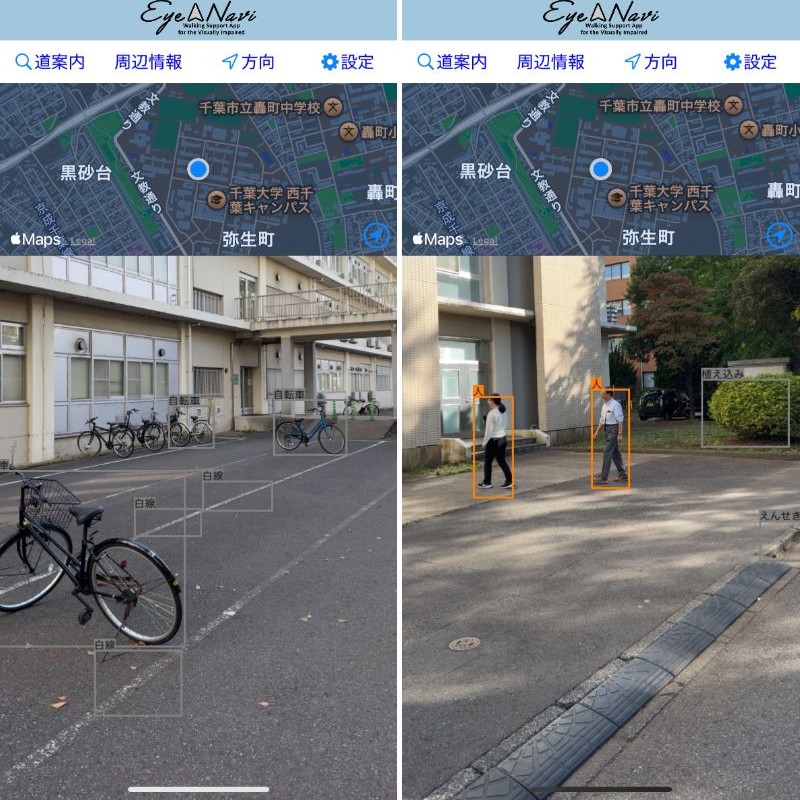

今回の研究会では、株式会社コンピュータサイエンス研究所の先進的な取り組みをご紹介いただくとともに、視覚に障害のある方の歩行を支援するアプリ『EyeNavi』を参加者で実際に体験しました。『EyeNavi』はAIの画像認識技術を用いて、進路上の障害物や信号の色などを検出して、音声で情報を伝えるアプリです。

講演の中では『EyeNavi』を用いた千葉大学との連携や東京都立大学などの事例もたくさんご紹介いただきました。

本レポートでは、講演会やアプリの体験会の様子を詳しくお伝えします。先進的な福祉教育やAI技術の活用に関心のある方は、ぜひ最後までお読みください。

前職では位置情報サービス制作。留学、起業などを経て、視覚障がい者歩行支援アプリ制作へ

今回の研究会では、株式会社コンピュータサイエンス研究所 営業企画・企画開発統括部長 髙田 将平さんに講演いただきました。

髙田さんは、前職の株式会社ゼンリンデータコムでは位置情報サービス制作を担当され、また、退職後にはアイルランド留学や起業経験、インド・バンガロールのIT企業にて内部統制に従事していたご経験もあるそうです。

その後、2015年に株式会社コンピュータサイエンス研究所に参画した髙田さん。現在は、視覚障がい者歩行支援アプリ『EyeNavi』に関わり、国の支援事業の統括・プロマネを担当しています。

講演の前半では、視覚障がい者が抱える課題やアプリ『EyeNavi』の説明をしていただきました。

ヘルパーの利用制限や盲導犬の限界。視覚障がい者が抱える課題をテクノロジーで解決

髙田さんは講演の前半で、視覚障がい者を取り巻く課題についてお話くださいました。

まず、移動のためのヘルパー利用についてです。視覚障がい者が家族ではないヘルパーと外出する際には、事前に予約が必要で、さらに利用時間にも制限があります。このため、視覚障がい者にとって、健常者のように「今すぐ出かけたい」と思ったときに外出することは困難です。加えて、ヘルパーは通勤や通学といった日常的な移動の際に使用できないというルールもあります。

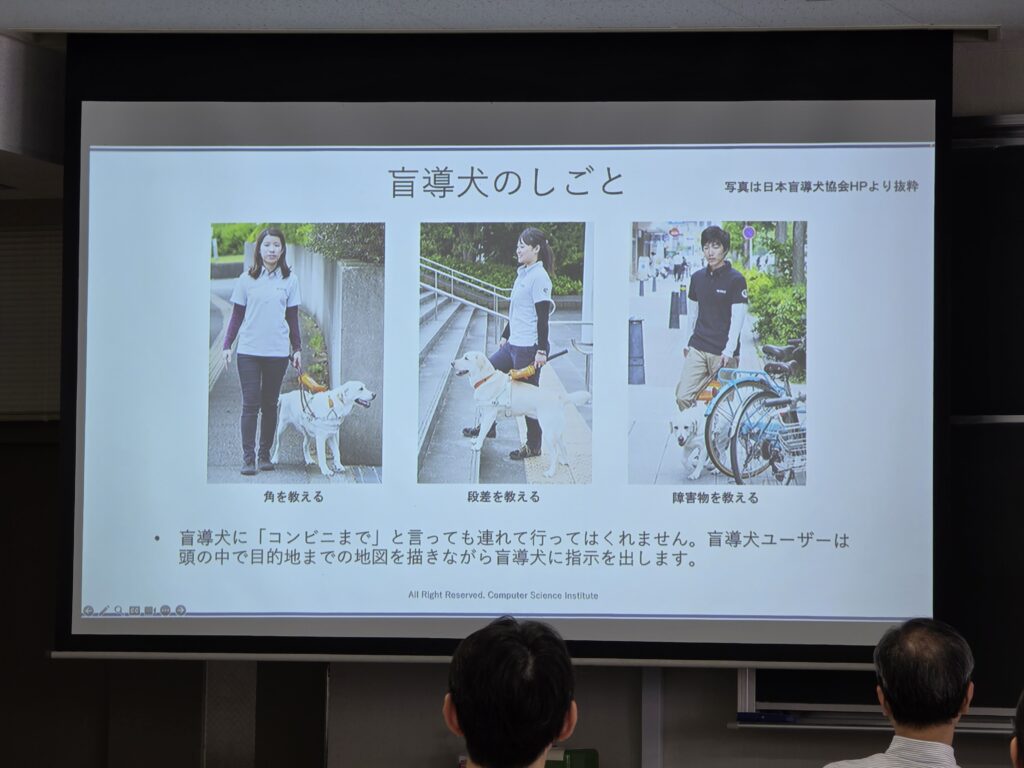

また、視覚障がい者が利用する盲導犬にも課題があります。盲導犬の仕事は、「角を教える」「段差を教える」「障害物を教える」の3つに限定されています。そのため、たとえば「コンビニまで」と指示しても道案内はできません。盲導犬ユーザーは、目的地までの道のりをすべて頭の中で把握しておく必要があるのです。

さらに、盲導犬は歩行者信号の色を判別できません。「周りの人が横断歩道を渡っているから安全」という状況判断をするため、信号の色を確実に認識できるわけではないのです。

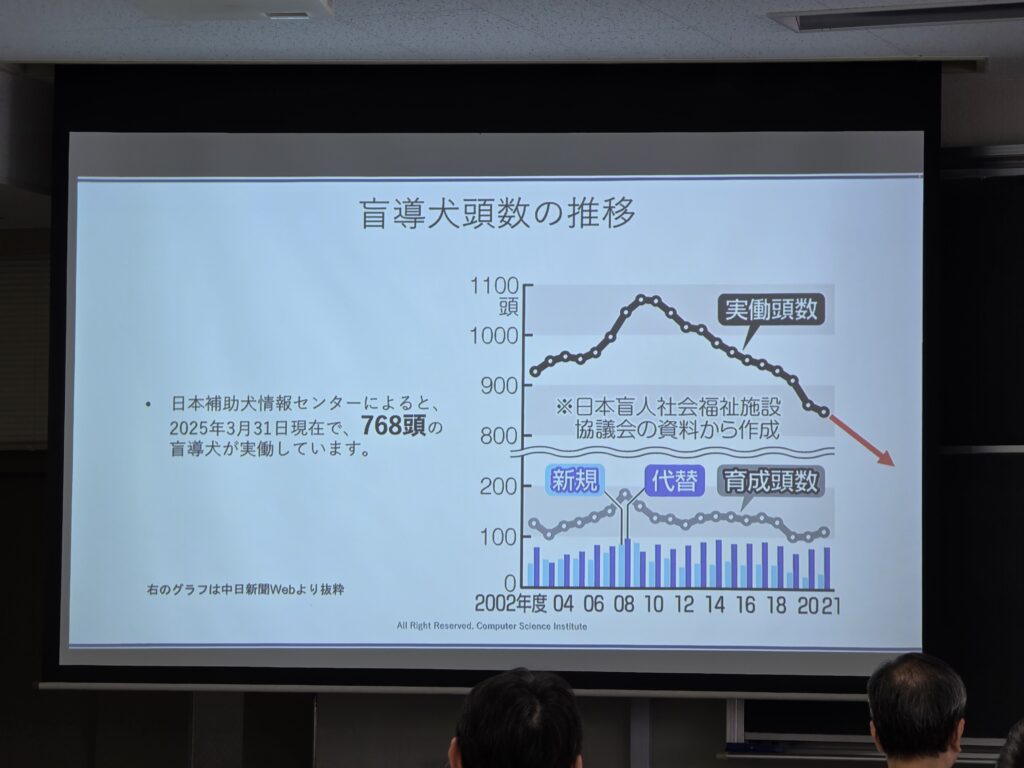

2025年3月31日現在で実働している盲導犬は768頭ですが、盲導犬を希望して待機している人は3,000人ほどいます。盲導犬は1頭あたり訓練に2~3年かかり、訓練費用に500万円ほどかかるので、希望数の確保が難しい現状があります。

また、盲導犬は大切な歩行パートナーですが、活動期間はおおむね4〜5年とされ、引退後には新しい犬との出会いが必要になります。このほか、盲導犬の日々の世話が必要であることや、すべての店で盲導犬を連れて入れるわけではない課題があることも踏まえると、視覚がい者の方々が気軽に外出できるという状態にはまだほど遠いといえるでしょう。

AIがカメラで信号の色を判断!スマホ用アプリ『EyeNavi』とは

このように、現状課題が多い視覚障がい者の外出について、力強くサポートするのが、スマートフォン用アプリ『EyeNavi』です。

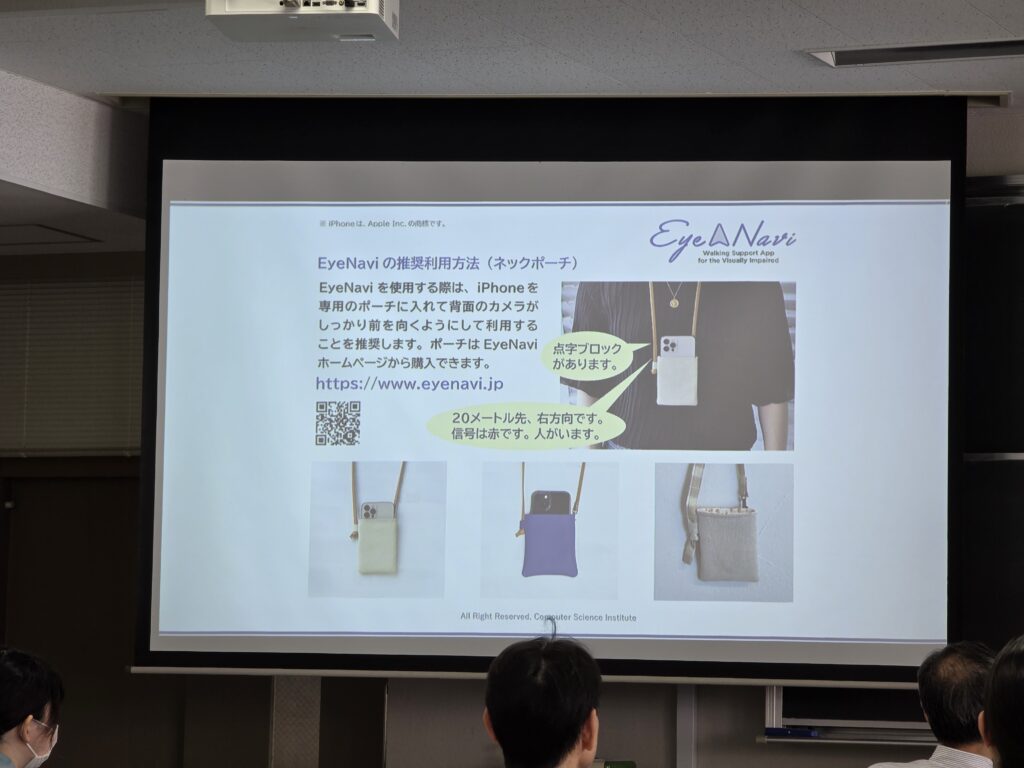

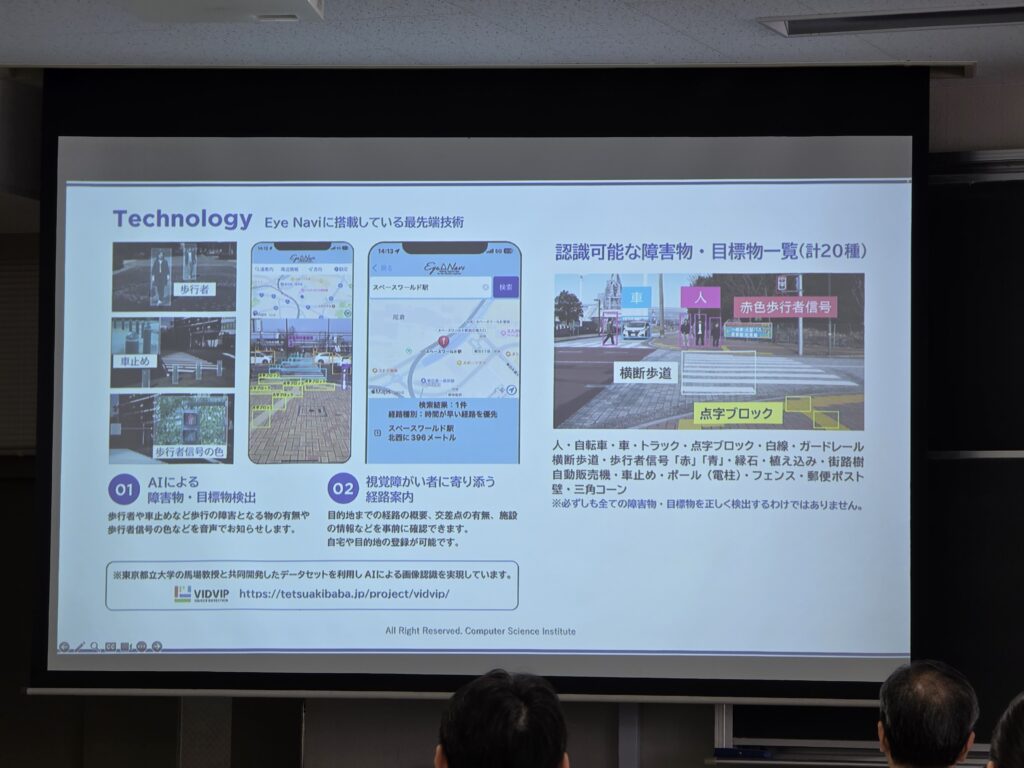

『EyeNavi』は、スマートフォンのカメラを通してAIが20種類の物体を瞬時に判断し音声出力して、ユーザーに伝えてくれるアプリです。歩行時には、ネックポーチにiPhoneを入れてカメラを進行方向に向けることが推奨されています。アプリは1秒間に複数回の処理を行っているため、多少スマホのブレがあっても問題なく動作するそうです。

このアプリは特に信号機の色を判別できる機能が画期的で、盲導犬の課題を克服してくれます。全盲の方だけでなく、弱視や色弱の方にも役立ちます。

また、『EyeNavi』には、外出時のトラブルに備える「歩行レコーダー機能」が搭載されています。これは、自動車のドライブレコーダーのように歩行中の映像を自動で保存する機能です。これにより、外出先で何かの被害に遭った際などには記録された映像を支援者に確認してもらうことができます。今までは、残念ながらいたずらを受けるなどの被害があっても、状況が分からず泣き寝入りせざるを得ないことも多かったそうです。

『EyeNavi』は、視覚障がい者の約8割がiPhoneを利用しているという背景から、iPhoneのみに対応しています。

『EyeNavi』は、基本機能を無料で提供しており、協賛企業からの支援で運営されています。しかし、安定的な開発のために、月額1,000円のプレミアム機能も搭載されました。プレミアム機能では、ChatGPTが連動し、撮影した写真から「入口はどこにあるか」「レストランのメニューを読み上げてほしい」といった、より複雑な質問にも回答してくれるようにもなっています。

開発当初は、AIの色の識別精度が低く、駐車場の満車・空車表示や店の看板を信号機だと間違えてしまうといった課題もありました。しかし、技術的な見直しを重ね、具体的な対象物との関連付けによって精度を向上させています。

『EyeNavi』はあくまで「歩行時の参考になるもの」という位置づけですが、利用者からは「外出時には常に動作させており、使わないと不安になるぐらい」「今や、なくてはならないもの」といった声が寄せられています。また、盲導犬ユーザーの方々も盲導犬と『EyeNavi』を併用することで、より安全かつ便利に移動できるそうです。

研究会参加者による『EyeNavi』の体験会の様子

講演の合間には、千葉大学西千葉キャンパス内で、『EyeNavi』体験会が実施されました。

アプリを実際に起動すると、画面に映る物体を即座に解析し、「人、人、自転車…」などと音声で、画面内の障害物や目標物の情報を伝えてくれます。白線や自転車、植え込み、縁石など20種類を検出できるようです。単に人がいることだけを伝えるのではなく、「正面に人がいる」といった情報も伝えてくれるため、衝突防止にも役立ちます。

『EyeNavi』の大きな特長として、利用者自身が使いやすいように調整できる点が挙げられます。デフォルト設定では検出する障害物や範囲が絞られていますが、「自転車」「人」など音声出力する障害物を自分で選ぶことで、利用者が必要な情報だけを取捨選択できる仕組みになっているのです。

また、アプリ内の設定画面は極力シンプルに作られており、体験会の参加者も直感的に操作できるようでした。また、主に視覚障がい者の方が使うアプリであるため、自分がどの画面を操作しているのかも音声で案内してくれます。

さらに、単にアプリが目的地への道案内をするだけではなく、「お散歩モード」も搭載されています。視覚障がい者にとって外出は大きなハードルになりますが、このアプリを使いこなせば、目的の場所に移動するだけでなく、気ままに自由に散歩する楽しみにも役立ちそうです。

基本機能は無償で提供されているため、多くの人が外出を楽しむきっかけになり得るアプリだと感じました。

『EyeNavi』の技術を産官学民の多くの団体と連携。新たな視覚障がい者支援へつなげる

『EyeNavi』の開発チームは、産官学民の多様な団体との連携を進めているそうです。ここでは、講演中に髙田さんに説明いただいた取り組みのうち、いくつかピックアップしてご紹介します。

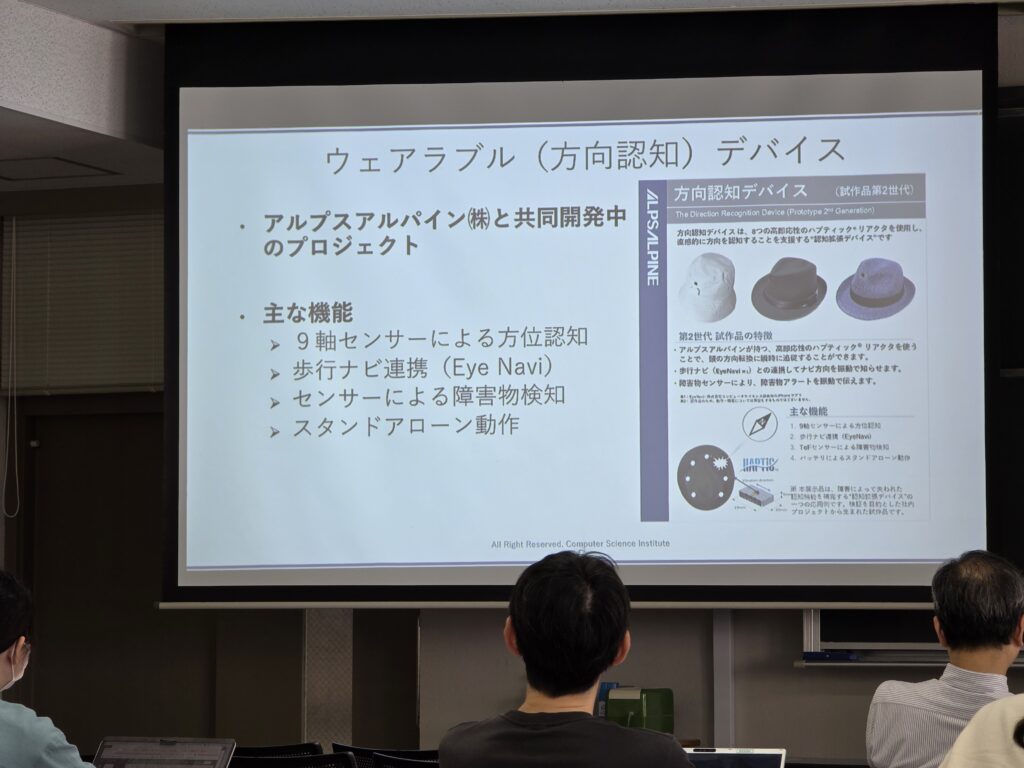

まずは、アルプスアルパイン株式会社の当事者社員の発案による「ウェアラブル(方向認知)デバイス」を共同開発中であるとお話いただきました。

これは頭にセンサーを装着することが想定された商品です。頭の方向転換のたびに9軸センサーで方位を認知し、『EyeNavi』のナビ情報やセンサーによる障害物検知を振動で知らせてくれます。

センサーを帽子につけることで、視覚障がい者が遭遇しやすい、顔や頭に物が当たる事故を防ぐことができるそうです。

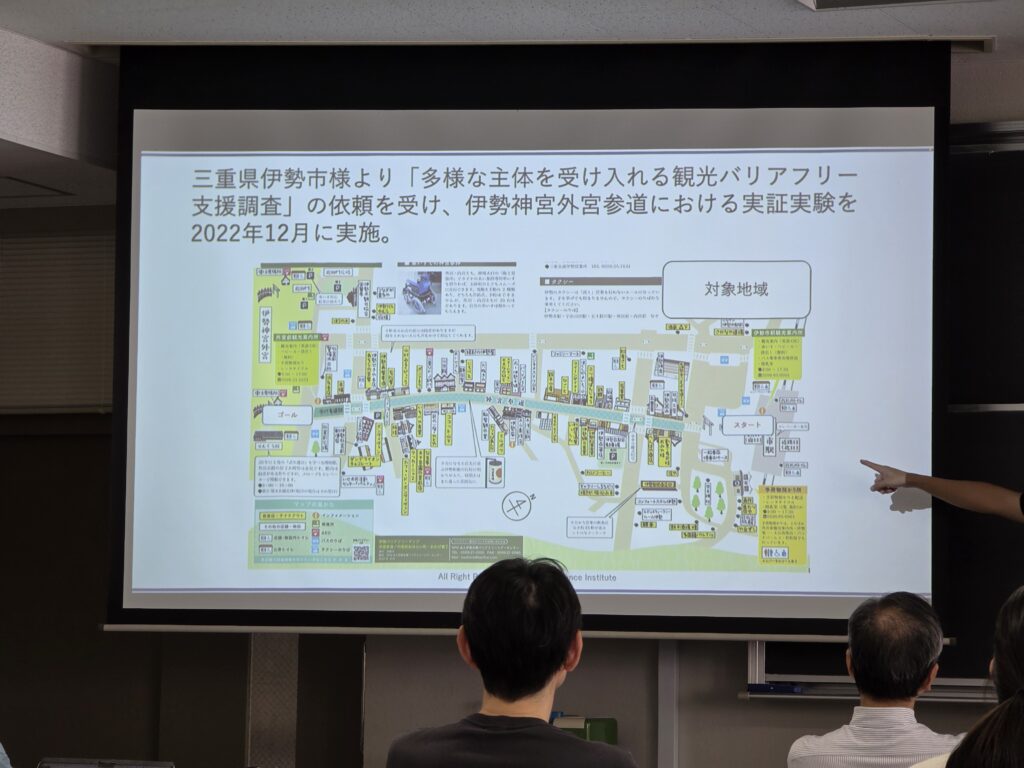

次に、三重県伊勢市との取り組みを紹介します。「多様な主体を受け入れる観光バリアフリー支援調査」の依頼を受け、株式会社コンピュータサイエンス研究所では2022年12月に実証実験を行いました。

実証実験は、対象地域である伊勢神宮外宮参道を視覚障がい者に『EyeNavi』を使用しながら歩いてもらうというもの。この際に使用するアプリは、対象地域の観光情報を音声案内できるようになっています。

髙田さんによると、視覚障がい者が自分自身で観光情報を得られるようになることで、介助者も観光を楽しめる余裕が出てくるそうです。

今後は、アプリの中で観光用のパッケージをダウンロードできるようにも準備を進めているそうです。視覚障がい者が自分ひとりで旅ができるようになる未来にも期待ができそうですね。

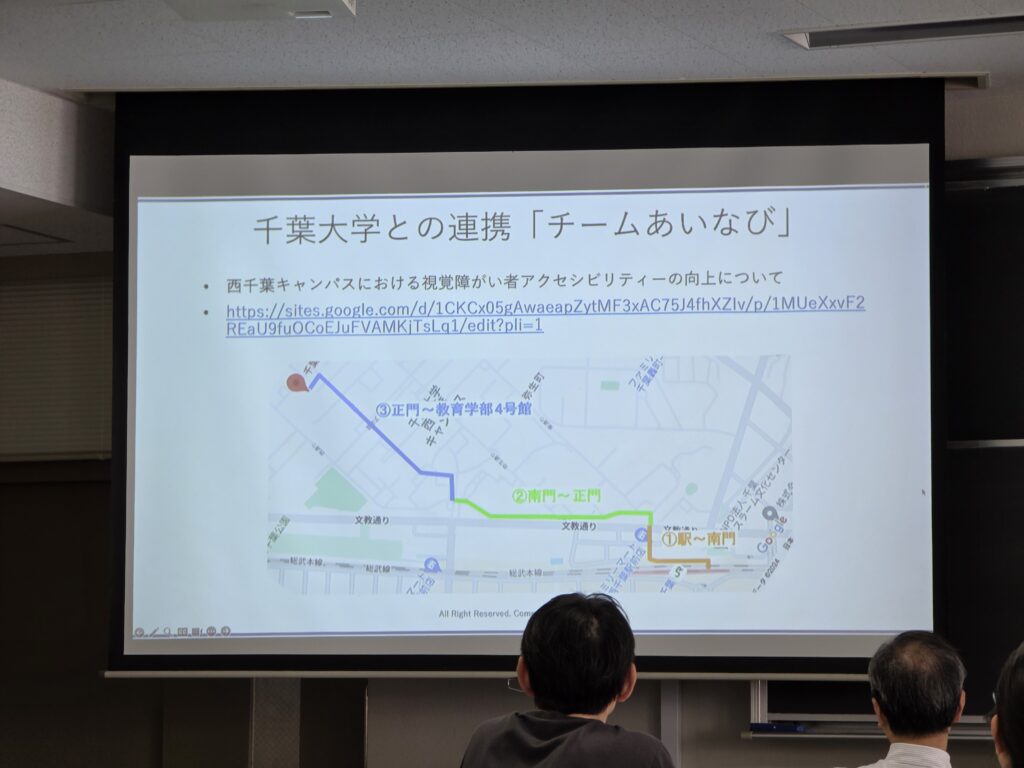

また、千葉大学との連携「チームあいなび」についてもお話いただきました。これは『EyeNavi』の「マイルート」機能を使って、大学内の建物の入り口まで案内するナビを準備する取り組みです。

最適なルートや歩行支援情報を、視覚障がい者や歩行訓練士の方と検証しながらルートを作成します。千葉大学は広いキャンパスであるものの、点字ブロックが一部にしかないことが視覚障がい者の歩行にとって大きな課題となります。『EyeNavi』の音声出力によって、大学内の移動の助けとなることが期待されます。

千葉大学に限らず、全国の大学にも広めたい取り組みであると、髙田さんはお話してくださりました。

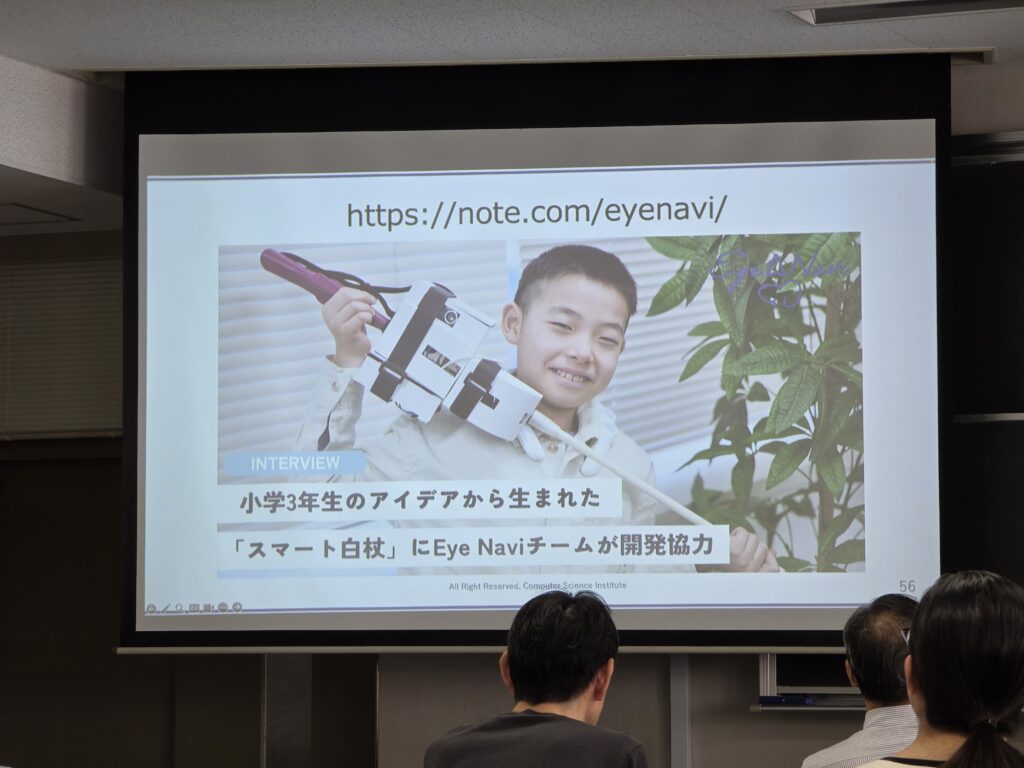

さらに印象的な事例として、小学三年生の男の子との協働エピソードも紹介されました。

NHKのニュースで『EyeNavi』を見た彼は、「視覚障害の方の役に立つ電子白杖を自分でも作りたい」と連絡をくれたそうです。

髙田さんのチームによるオンラインでのアドバイスをもとに、彼は距離センサーを組み合わせた電子白杖を完成させました。障害物に近づくと光と音で知らせる仕組みの作品で、表彰も受けたといいます。

「子どもの自由な発想が新しい技術の原点になる」と髙田さん。

社会課題を自分ごととして考え、行動に移した象徴的なエピソードとして紹介されました。

「視覚障害という概念がない世の中にしたい」-これからの展望-

『EyeNavi』開発チームは、「視覚障害という概念がない世の中にしたい」という大きな目標を掲げ、さらなる技術開発を進めています。

現在検討されているのは、物体検出だけではなく「領域検出」の導入です。これを実現することで、AIが路面を面として捉えられるようになり、例えば横断歩道をよりまっすぐ、安全に歩けるようになることが期待されます。さらに、2030年には、高度な案内が可能な犬型ロボットの実現を目指しています。

また、スマートフォンアプリの枠を超え、スマートグラスとの連携も視野に入れています。例えば、「Ray-Ban × Meta スマートグラス」のようなデバイスとAIを連携させれば、目の前にある物体を説明してもらうことができ、より日常生活が便利になるでしょう。これは、ユーザーからの「知り合いの顔を覚えて、自分から声をかけられるようにしたい」という要望に応えるものでもあります。

現在、世界には視覚障がい者が約3億4,000万人いるとされています。そして、身体障がい者手帳の取得に至らないものの、見えにくさを抱えている人は日本国内だけで160万人いると見られています。さらに健康寿命が伸びるにつれ、この数は200万人に増えると予想されています。

このような状況の中、『EyeNavi』をはじめとするテクノロジーの活用を通して、誰もが暮らしやすい社会を実現するための開発が行われています。少し先の「視覚障害」の概念がない社会の実現への期待が高まる講演でした。

ディスカッション

研究会の後半には、千葉授業づくり定番のディスカッションが行われました。オンライン上で質問ができるサービス「Slido」を使い、参加者と登壇者で議論を行います。

ディスカッションの中では、『EyeNavi』を用いたアイデアもたくさん生まれました。ここからは、ディスカッションの内容を一部抜粋要約してご紹介します。

Q.学校教育の中で活用することはできますか?

はい。児童生徒が地域を歩きながら、横断歩道や建物などの情報を撮影し、『EyeNavi』の地図上に入力していくという学習が考えられます。アプリには歩行中にコメントを残せる機能もあるため、地域の安全マップづくりや総合的な学習の時間での探究活動にも活かせそうです。

Q.GIGAスクール端末で子どもたちに地域の画像を撮影してもらい、データ収集に協力することもできそうですね。データの収集の際に気をつけることはありますか?

撮影の際に対象物を画面に収める位置をある程度統一させたいので、ルール作りをしています。

例えば、横断歩道の撮影であればマーカーとして白黒の枠をアプリに表示させれば、誰でも枠に合わせて撮影できるようになります。

Q.どんな学びの効果が期待できますか?

視覚障害の理解にとどまらず、地域の課題を自分たちで発見し、解決策を考える「社会とつながる学び」になることが期待されます。自分たちの調査データがアプリを通して誰かの役に立つことで、子どもたちの探究心や社会参画意識を育む授業に発展できそうです。

Q.視覚障害の支援だけでなく、ほかの人にも役立ちますか?

はい。外国にルーツを持つ子どもや高齢者など、さまざまな人にとって使いやすいアプリとしての可能性もあります。多言語での音声案内や振動によるサインなど、より包摂的な社会づくりへの応用も議論されました。

Q.ユーザーからの要望がたくさんあると思いますが、御社のリソースが限られている中で優先して解決したい課題はありますか

領域検出で横断歩道をまっすぐ歩けるようにすることです。

また、音声を前提としている現在の仕様だと使いにくく感じる人もいることも課題です。振動で障害物の存在を教えてほしいという声もあります。

Q.『EyeNavi』の精度で物体を判別できるのなら、車や自転車などに搭載されれば視覚障害がない人の事故防止にも役立ちそうだと感じました

はい。自転車や電動車いす、シニアカーなどでも役立つのではないかと考えております。

ディスカッションでは、福祉的な視点とICT/テクノロジーを融合させることの大切さや、それが教育テーマとして非常に有効で、高い教育効果を生むという点について議論が深まりました。

特に、「地域の課題を発見するだけでなく、その場で解決策を入力し、解決に向けて具体的に取り組める」という仕組みは、総合的な学習の時間としても画期的であるという意見が出され、大きな盛り上がりを見せました。

テクノロジーを活用した社会課題の理解や探究的な学びなど、授業づくりの新たな可能性が見えてきたディスカッションとなりました。

以上で、第172回千葉授業づくり研究会のレポートのご報告とします。ご講演いただきました髙田さん、参加者のみなさま、誠にありがとうございました。

千葉授業づくり研究会の参加方法

千葉授業づくり研究会にはどなたでも参加できます。

興味がある方は、こちらの開催情報をチェックしてくださいね!Zoomを用いたオンライン配信による参加もできるので、遠方の方も大歓迎です。

【記事担当:千鳥あゆむ】